结合官网以及两篇高质量博客学习Spark性能调优,摘要几点加深理解

原文:

Spark性能优化指南——基础篇

Spark性能优化指南——高级篇

官方文档

了解资源调优,需要首先知道spark的运行流程,要了解运行流程需要了解一些相关概念

1、Spark相关概念

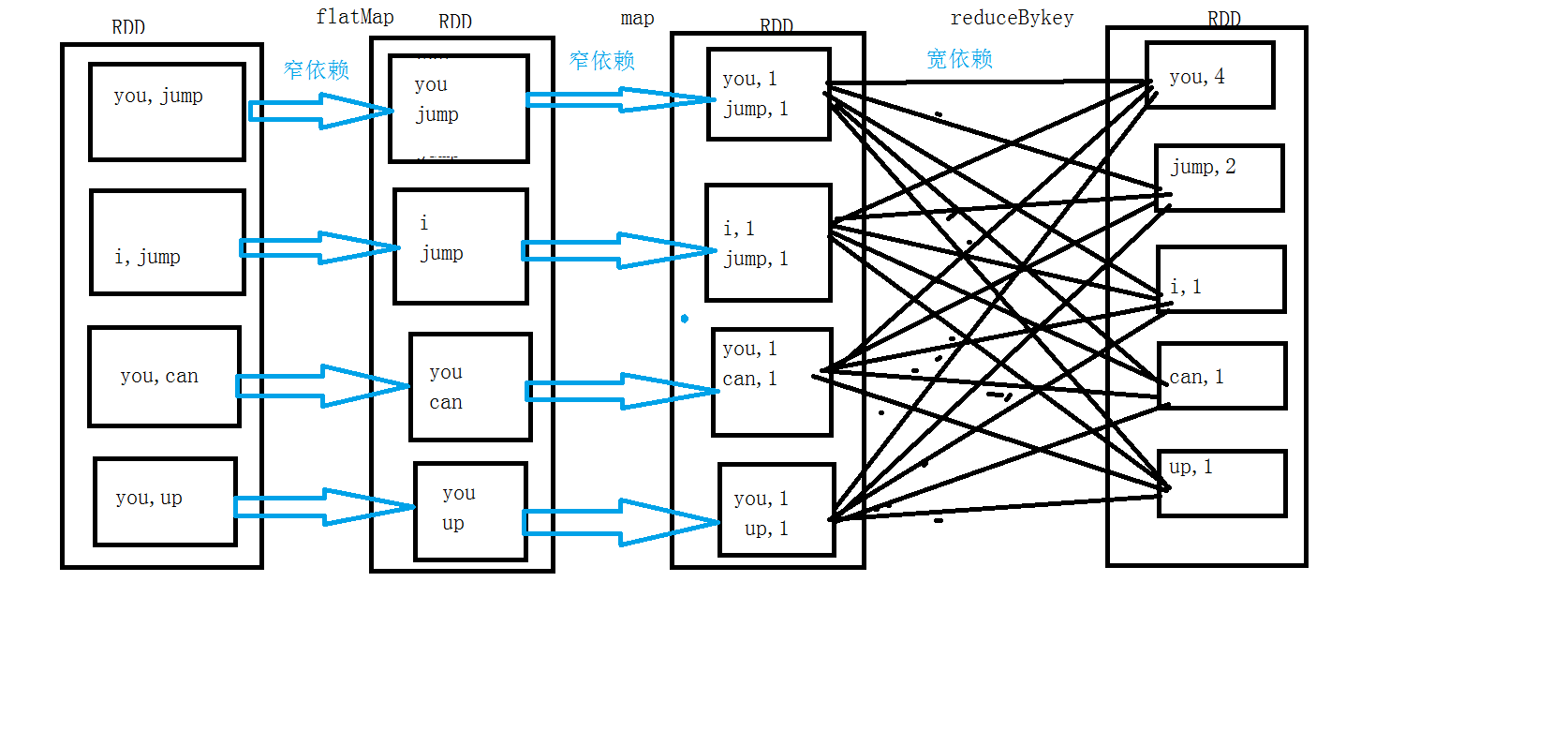

宽依赖和窄依赖

rdd具有依赖性

在RDD中将依赖分为了两种类型:窄依赖和宽依赖。

窄依赖:指父RDD的每个分区都只被子RDD的一个分区所依赖。

宽依赖:指父RDD的分区被子RDD的多个子分区所依赖。

一般来说shuffle阶段为宽依赖,非shuffle阶段为窄依赖,具体情况根据定义进行划分

Application

指的是我们开发的spark应用程序。我们开发好代码以后去提交任务这就是一个application

Deploymode

Client:在哪儿提交代码哪台服务器就是Driver

cluster:会把Dirver发送到集群的不同机器上。

Executor

我们的任务是需要运行在Executor里面的

Job

我们提交的一个application里面可以有多个job。一个application里面每遇到一个action的操作就会生成一个job。

Stage

我们一个job任务的执行时需要分阶段的。

Task

最小的代码执行的逻辑单元

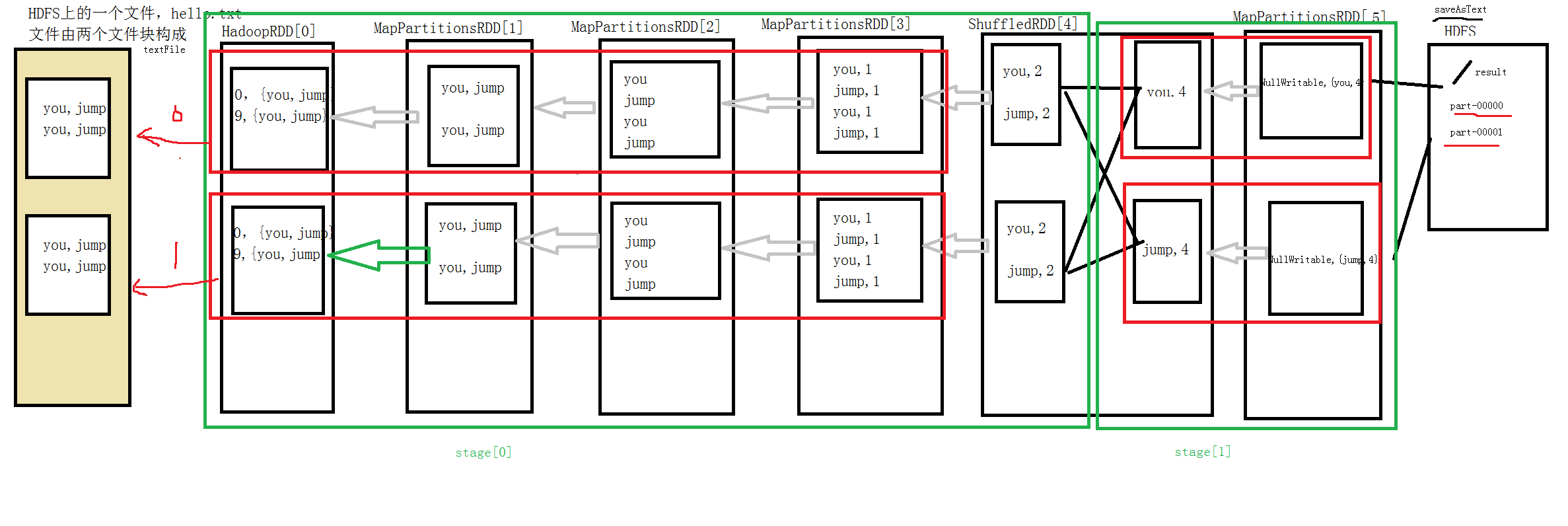

Application ->Job -> Stage -> Task

提交的整个spark任务为一个application,根据任务里面的action算子可以将application划分为多个job,每个job按照宽依赖划分为多个stage,每个stage按照处理数据不同(默认numslice数目)划分为不同的task

上图为一个job,从最后的action算子开始向前递推,遇到宽依赖(shuffle)划分stage,然后继续向前递推,知道没有rdd结束,递推使用的DAG(有向无环图)

图中绿色区域为划分的stage,上图划分为2个stage

根据numslice在stage内部划分task,task是spark最小代码执行逻辑单元,图中红色部分为task,每个stage包含2个task,stage执行是顺序进行的,不同stage的task不一定相同,需要看shuffle后的分区数目

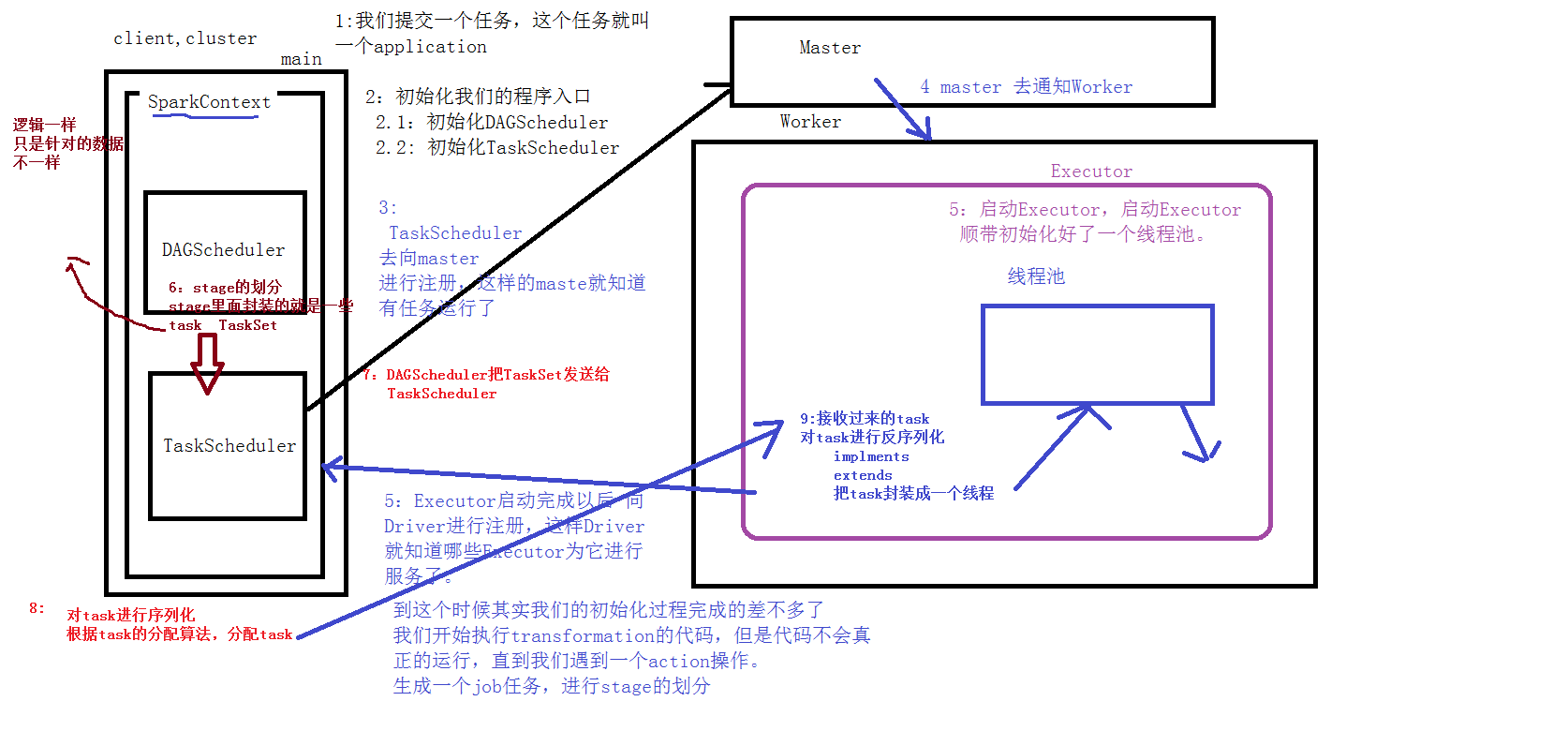

2、spark运行流程

详细流程分为以下过程:

spark分为不同运行模式,常用的standalone和on yarn模式,上图为standalone模式

<1>提交任务

在集群某个节点提交任务&#xff0c;有client模式和cluster模式&#xff0c;以client为例。任务提交后&#xff0c;启动Driver&#xff0c;driver包含DAGScheduler和TaskScheduler。根据你使用的部署模式&#xff08;deploy-mode&#xff09;不同&#xff0c;Driver进程可能在本地启动&#xff0c;也可能在集群中某个工作节点上启动。Driver进程本身会根据我们设置的参数&#xff0c;占有一定数量的内存和CPU core。

<2>初始化driver

对于程序来说即&#xff1a;sc &#61; new SparkContext(conf)

分别初始化DAGScheduler和TaskScheduler

<3>driver向master注册

完成初始化后&#xff0c;TaskScheduler将master进行注册&#xff0c;就是向集群管理器&#xff08;可以是Spark Standalone集群&#xff0c;也可以是其他的资源管理集群&#xff0c;是YARN作为资源管理集群&#xff09;申请运行Spark作业需要使用的资源&#xff0c;这里的资源指的就是Executor进程。

<4>master进行资源分配

master集群管理器会根据我们为Spark作业设置的资源参数&#xff0c;在各个工作节点worker上&#xff0c;启动一定数量的Executor进程&#xff0c;每个Executor进程都占有一定数量的内存和CPU core。

<5>启动Executor&#xff0c;并向driver注册

启动executor&#xff0c;并且在executor中启动线程池&#xff0c;然后向driver进行注册&#xff0c;driver即可得知master给分配的资源

然后开始解析需要运行的代码

sc.textFile("D:\\a\\a.txt").map(a&#61;>(new secondSort(a.split(",")(0).toInt,a.split(",")(1).toInt),a)).sortByKey().foreach(a&#61;>println(a._2&#43;"\t"))

transformation代码不会被立即执行&#xff0c;只用在遇到action算子时&#xff0c;划分为不同的job

<6>DAGScheduler进行stage划分

DAGScheduler根据有向无环图对job进行stage划分&#xff0c;stage划分原则是逆推&#xff0c;遇到宽依赖即为不同stage&#xff0c;直到没有RDD结束&#xff0c;然后将stage划分为task&#xff0c;形成taskSet&#xff0c;即任务集合

<7>传递taskSet

DAGScheduler将不同stage形成的taskSet发送给TaskScheduler

<8>序列化task并分发task

TaskScheduler接收到taskSet&#xff0c;然后进行序列化&#xff0c;根据task分发算法进行task分发&#xff0c;将task分发到executor

<9>执行task

executor接收到task后&#xff0c;进行反序列化&#xff0c;然后按照分配的资源进行计算&#xff0c;每一个task对应一个线程

<10>形成结果

一个stage的所有task都执行完毕之后&#xff0c;会在各个节点本地的磁盘文件中写入计算中间结果&#xff0c;然后Driver就会调度运行下一个stage。下一个stage的task的输入数据就是上一个stage输出的中间结果。如此循环往复&#xff0c;直到将我们自己编写的代码逻辑全部执行完&#xff0c;并且计算完所有的数据&#xff0c;得到我们想要的结果为止。

3、资源调优

Executor的内存主要分为三块&#xff1a;第一块是让task执行我们自己编写的代码时使用&#xff0c;默认是占Executor总内存的20%&#xff1b;第二块是让task通过shuffle过程拉取了上一个stage的task的输出后&#xff0c;进行聚合等操作时使用&#xff0c;默认也是占Executor总内存的20%&#xff1b;第三块是让RDD持久化时使用&#xff0c;默认占Executor总内存的60%。

task的执行速度是跟每个Executor进程的CPU core数量有直接关系的。一个CPU core同一时间只能执行一个线程。而每个Executor进程上分配到的多个task&#xff0c;都是以每个task一条线程的方式&#xff0c;多线程并发运行的。如果CPU core数量比较充足&#xff0c;而且分配到的task数量比较合理&#xff0c;那么通常来说&#xff0c;可以比较快速和高效地执行完这些task线程。

理解作业基本原理&#xff0c;是我们进行资源参数调优的基本前提。

所谓的Spark资源参数调优&#xff0c;其实主要就是对Spark运行过程中各个使用资源的地方&#xff0c;通过调节各种参数&#xff0c;来优化资源使用的效率&#xff0c;从而提升Spark作业的执行性能。

资源调优主要从以下方面进行&#xff1a;

<1>num-executors

- 参数说明&#xff1a;该参数用于设置Spark作业总共要用多少个Executor进程来执行。Driver在向YARN集群管理器申请资源时&#xff0c;YARN集群管理器会尽可能按照你的设置来在集群的各个工作节点上&#xff0c;启动相应数量的Executor进程。这个参数非常之重要&#xff0c;如果不设置的话&#xff0c;默认只会给你启动少量的Executor进程&#xff0c;此时你的Spark作业的运行速度是非常慢的。

- 参数调优建议&#xff1a;每个Spark作业的运行一般设置50~100个左右的Executor进程比较合适&#xff0c;设置太少或太多的Executor进程都不好。设置的太少&#xff0c;无法充分利用集群资源&#xff1b;设置的太多的话&#xff0c;大部分队列可能无法给予充分的资源。

<2>executor-memory

- 参数说明&#xff1a;该参数用于设置每个Executor进程的内存。Executor内存的大小&#xff0c;很多时候直接决定了Spark作业的性能&#xff0c;而且跟常见的JVM OOM异常&#xff0c;也有直接的关联。

- 参数调优建议&#xff1a;每个Executor进程的内存设置4G~8G较为合适。但是这只是一个参考值&#xff0c;具体的设置还是得根据不同部门的资源队列来定。可以看看自己团队的资源队列的最大内存限制是多少&#xff0c;num-executors乘以executor-memory&#xff0c;是不能超过队列的最大内存量的。此外&#xff0c;如果你是跟团队里其他人共享这个资源队列&#xff0c;那么申请的内存量最好不要超过资源队列最大总内存的1/3~1/2&#xff0c;避免你自己的Spark作业占用了队列所有的资源&#xff0c;导致别的同学的作业无法运行。

<3>executor-cores

- 参数说明&#xff1a;该参数用于设置每个Executor进程的CPU core数量。这个参数决定了每个Executor进程并行执行task线程的能力。因为每个CPU core同一时间只能执行一个task线程&#xff0c;因此每个Executor进程的CPU core数量越多&#xff0c;越能够快速地执行完分配给自己的所有task线程。

- 参数调优建议&#xff1a;Executor的CPU core数量设置为2~4个较为合适。同样得根据不同部门的资源队列来定&#xff0c;可以看看自己的资源队列的最大CPU core限制是多少&#xff0c;再依据设置的Executor数量&#xff0c;来决定每个Executor进程可以分配到几个CPU core。同样建议&#xff0c;如果是跟他人共享这个队列&#xff0c;那么num-executors * executor-cores不要超过队列总CPU core的1/3~1/2左右比较合适&#xff0c;也是避免影响其他同学的作业运行。

<4>driver-memory

- 参数说明&#xff1a;该参数用于设置Driver进程的内存。

- 参数调优建议&#xff1a;Driver的内存通常来说不设置&#xff0c;或者设置1G左右应该就够了。唯一需要注意的一点是&#xff0c;如果需要使用collect算子将RDD的数据全部拉取到Driver上进行处理&#xff0c;那么必须确保Driver的内存足够大&#xff0c;否则会出现OOM内存溢出的问题。

<5>spark.default.parallelism

- 参数说明&#xff1a;该参数用于设置每个stage的默认task数量。这个参数极为重要&#xff0c;如果不设置可能会直接影响你的Spark作业性能。

- 参数调优建议&#xff1a;Spark作业的默认task数量为500~1000个较为合适。很多同学常犯的一个错误就是不去设置这个参数&#xff0c;那么此时就会导致Spark自己根据底层HDFS的block数量来设置task的数量&#xff0c;默认是一个HDFS block对应一个task。通常来说&#xff0c;Spark默认设置的数量是偏少的&#xff08;比如就几十个task&#xff09;&#xff0c;如果task数量偏少的话&#xff0c;就会导致你前面设置好的Executor的参数都前功尽弃。试想一下&#xff0c;无论你的Executor进程有多少个&#xff0c;内存和CPU有多大&#xff0c;但是task只有1个或者10个&#xff0c;那么90%的Executor进程可能根本就没有task执行&#xff0c;也就是白白浪费了资源&#xff01;因此Spark官网建议的设置原则是&#xff0c;设置该参数为num-executors * executor-cores的2~3倍较为合适&#xff0c;比如Executor的总CPU core数量为300个&#xff0c;那么设置1000个task是可以的&#xff0c;此时可以充分地利用Spark集群的资源。

<6>spark.storage.memoryFraction

- 参数说明&#xff1a;该参数用于设置RDD持久化数据在Executor内存中能占的比例&#xff0c;默认是0.6。也就是说&#xff0c;默认Executor 60%的内存&#xff0c;可以用来保存持久化的RDD数据。根据你选择的不同的持久化策略&#xff0c;如果内存不够时&#xff0c;可能数据就不会持久化&#xff0c;或者数据会写入磁盘。

- 参数调优建议&#xff1a;如果Spark作业中&#xff0c;有较多的RDD持久化操作&#xff0c;该参数的值可以适当提高一些&#xff0c;保证持久化的数据能够容纳在内存中。避免内存不够缓存所有的数据&#xff0c;导致数据只能写入磁盘中&#xff0c;降低了性能。但是如果Spark作业中的shuffle类操作比较多&#xff0c;而持久化操作比较少&#xff0c;那么这个参数的值适当降低一些比较合适。此外&#xff0c;如果发现作业由于频繁的gc导致运行缓慢&#xff08;通过spark web ui可以观察到作业的gc耗时&#xff09;&#xff0c;意味着task执行用户代码的内存不够用&#xff0c;那么同样建议调低这个参数的值。

<7>spark.shuffle.memoryFraction

- 参数说明&#xff1a;该参数用于设置shuffle过程中一个task拉取到上个stage的task的输出后&#xff0c;进行聚合操作时能够使用的Executor内存的比例&#xff0c;默认是0.2。也就是说&#xff0c;Executor默认只有20%的内存用来进行该操作。shuffle操作在进行聚合时&#xff0c;如果发现使用的内存超出了这个20%的限制&#xff0c;那么多余的数据就会溢写到磁盘文件中去&#xff0c;此时就会极大地降低性能。

- 参数调优建议&#xff1a;如果Spark作业中的RDD持久化操作较少&#xff0c;shuffle操作较多时&#xff0c;建议降低持久化操作的内存占比&#xff0c;提高shuffle操作的内存占比比例&#xff0c;避免shuffle过程中数据过多时内存不够用&#xff0c;必须溢写到磁盘上&#xff0c;降低了性能。此外&#xff0c;如果发现作业由于频繁的gc导致运行缓慢&#xff0c;意味着task执行用户代码的内存不够用&#xff0c;那么同样建议调低这个参数的值。

一个配置实例&#xff1a;

./bin/spark-submit \--master yarn-cluster \--num-executors 100 \--executor-memory 6G \--executor-cores 4 \--driver-memory 1G \--conf spark.default.parallelism&#61;1000 \--conf spark.storage.memoryFraction&#61;0.5 \--conf spark.shuffle.memoryFraction&#61;0.3 \