2019独角兽企业重金招聘Python工程师标准>>>

1)合适的用户

建议添加一个名为hadoop的用户方便记忆(其实什么用户都无大碍),不建议使用root!!具体方法自行检索,这里提供总体的过程梳理,下同。

2)合适的java版本

不建议使用Ubuntu自带的java版本,请自行下载并让当前用户使用。

3)openssh-server

Ubuntu默认只安装了ssh客户端,没有安装服务器端,安装ssh服务器端是必须的。

4)关闭防火墙

root权限用户:

iptables -F

2.用户的设置

1)修改hostname

Ubuntu的主机名(hostname)修改的位置是:/etc/hostname

建议修改为masterX或slaveX

2)修改hosts表

vi /etc/hosts 建立各集群主机名(hostname)与ip的对应关系

127.0.0.1这个本地回环地址只能映射为localhost,有多余的删除!(伪分布式可能使用,集群模式不能使用)

3)配置PATH、JAVA_HOME变量

配置~/.bashrc文件里的PATH、JAVA_HOME

3.hadoop2.7.3配置

修改几个配置文件:

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

和DataNode结点的主机名文件:

slaves

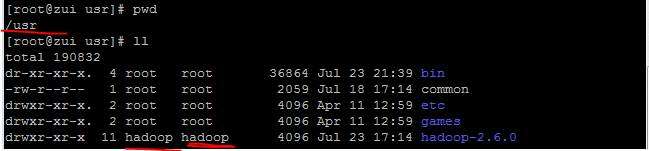

4.hadoop文件复制

将配置好的整个hadoop文件(第三步)复制到集群里所有的机器中(避免重复操作的不二选择0.o)

建议使用scp命令

5.设置ssh免密登录

master主机可以ssh免密登录所有的主机包括自己(localhost)。

master主机的当前用户产生ssh公私钥,将公钥发给所有机器的当前用户,所有的用户将该公钥保存到允许列表(authorized_key)里,master用自己的私钥实现身份认证从而免密登录。

6.NameNode结点的格式化

maser主机上执行

hdfs namenode -format

--

以上

京公网安备 11010802041100号

京公网安备 11010802041100号