作者:霞慧水灵灵_973 | 来源:互联网 | 2023-09-18 10:14

1.图像分类?2.神经网络原理?1.卷积神经网络介绍?2.利用caffe搭建深度网络做图像分类挑战:光照变化+形变。类内变化。标签、预测函数,泛化能力。如何提高泛化能力?需要用图像

1.图像分类 • 2.神经网络原理 • 1.卷积神经网络介绍 • 2.利用caffe搭建深度网络做图像分类

挑战:光照变化+形变。类内变化。

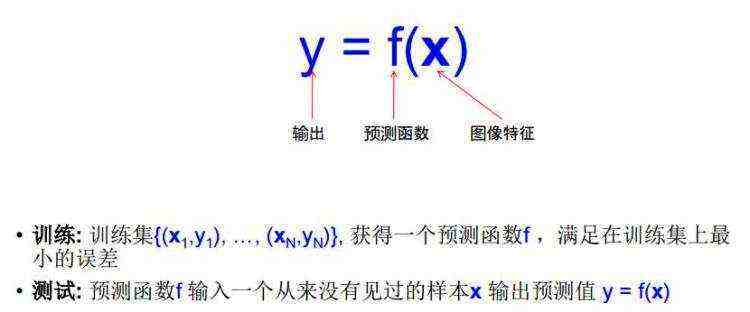

标签、预测函数,泛化能力。

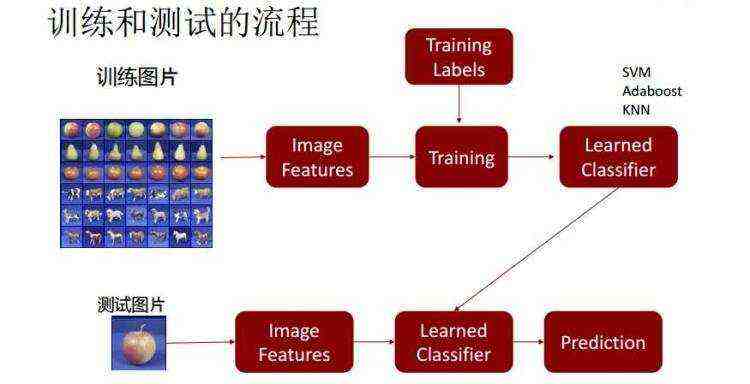

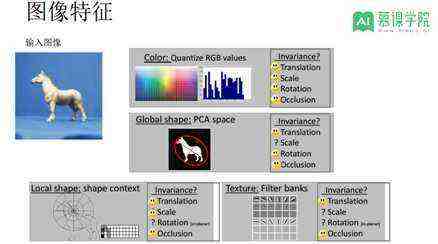

如何提高泛化能力?需要用图像特征来描述图像。

颜色特征:直方图。

形状特征:PCA降维。

局部特征细节、纹理。

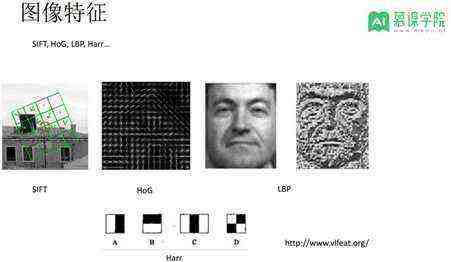

SIFT特征:局部,4*4区域的16格内,每个格子内算8维梯度,拼成128维特征。用于检测匹配。

HOG:检测目标形状。用于检测、跟踪。

LBP:对区域编码,适合处理人脸,对称的均匀的。可以有效捕捉响应。

Harr:滤波器。边缘。

VLFeat - Home http://www.vlfeat.org/

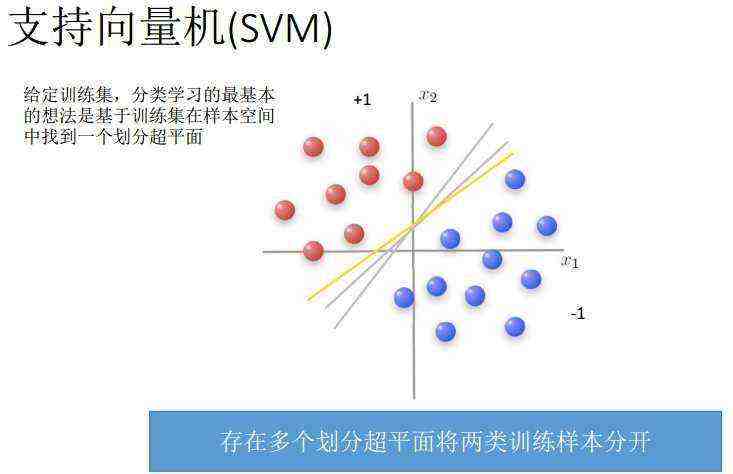

SVM分类:

最大化间隔:

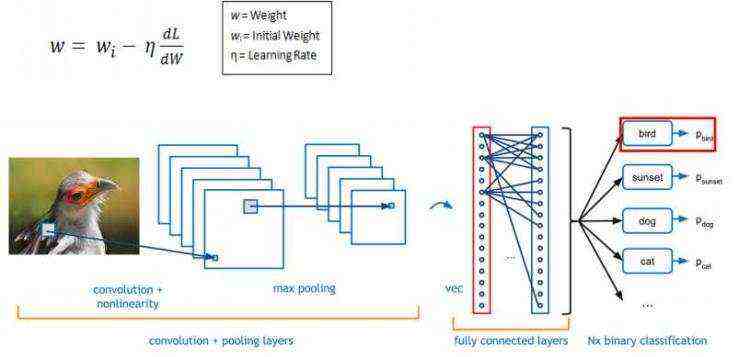

CNN特征:大量图像中学习出来的特征。Imagenet1000类。

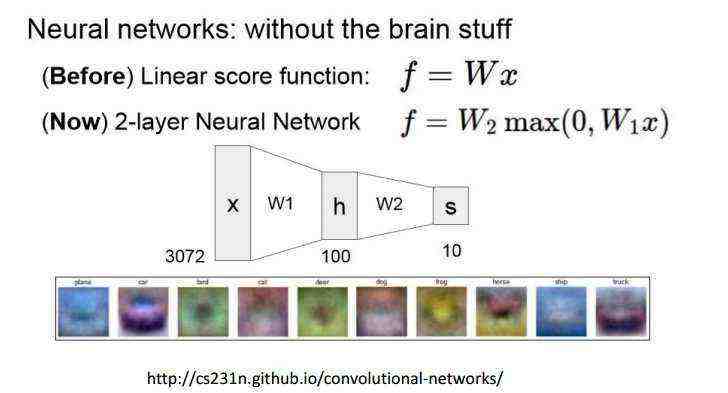

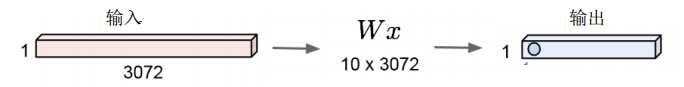

神经网络做图像分类:

CS231n Convolutional Neural Networks for Visual Recognition http://cs231n.github.io/convolutional-networks/

神经网络搭建:

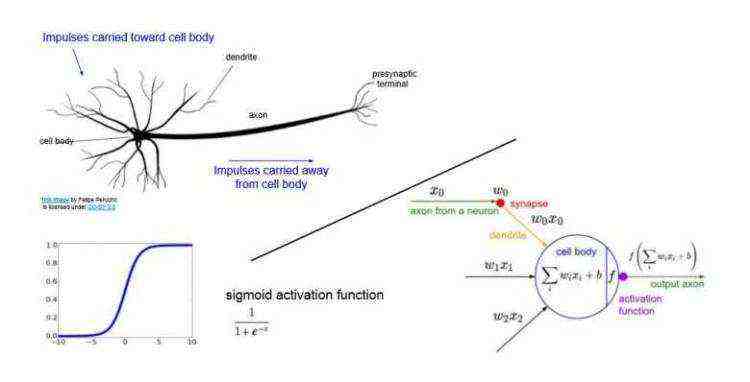

神经网络的基本单元:神经元

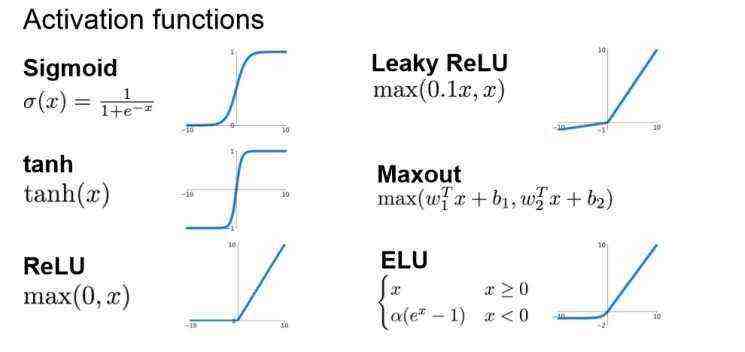

激励函数:

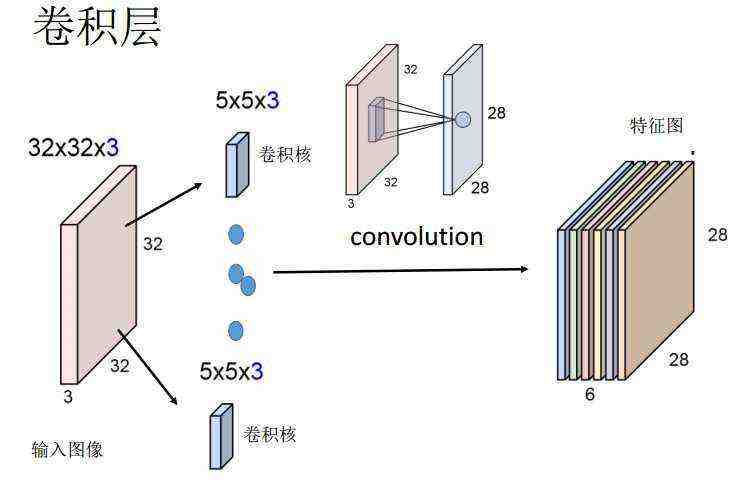

卷积层:

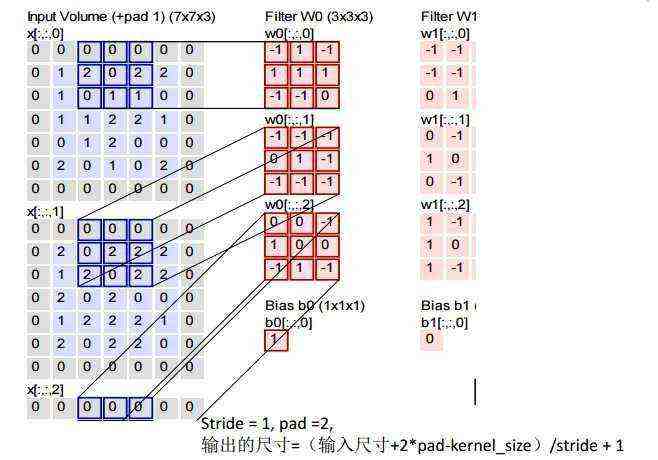

卷积滤波的计算:

Stride = 1, pad =2,

输出的尺寸=(输入尺寸+2*pad-kernel_size)/stride + 1

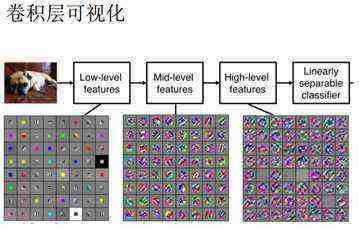

卷积层可视化:

卷积提取的特征为什么有效果。传统的只是表层特征,深层特征无法获得。

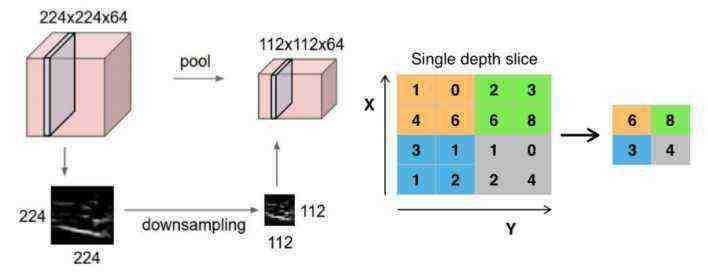

池化层(pooling layer):平均池化、最大池化。特征亚采样。

特征表达更加紧凑,同时具有位移不变性。

全连接层:全连接权重是W。

损失函数:

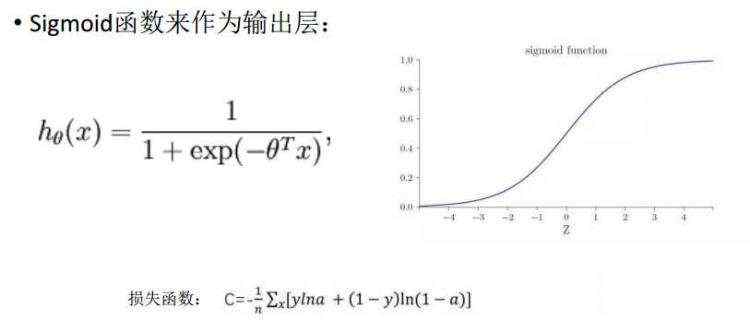

• SIGMOID_CROSS_ENTROPY_LOSS

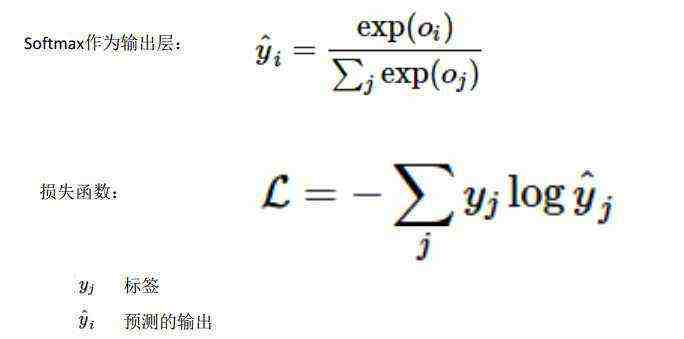

• SOFTMAX_LOSS

• EUCLIDEAN_LOSS

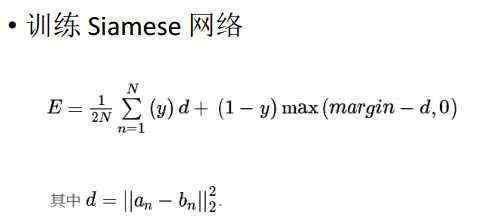

• Contrastive loss

• Triplet Loss

不同的task对应着不同的loss

交叉熵损失函数(SIGMOID_CROSS_ENTROPY_LOSS):

Sigmoid函数把负无穷到正无穷压缩到-1~+1。应用于二分类问题。

Softmax 损失函数(SOFTMAX_LOSS):多分类问题

欧式距离损失函数(EUCLIDEAN_LOSS):

对比损失函数(Contrastive loss):用于图像分类、检索。

训练 Siamese 网络,用来计算两个图像之间的相似度,image match。输入两张图。

Triplet loss:三元,输入三张图。

http://blog.csdn.net/tangwei2014/article/details/46788025

训练网络、测试

http://caffe.berkeleyvision.org/tutorial/forward_backward.html

Caffe 实现一个图像分类任务 • 安装教程 :

• Windows环境:http://www.cnblogs.com/trantor/p/4570097.html

• Linux环境:http://www.cnblogs.com/denny402/p/5067265.html