作者:SCY瑶_450 | 来源:互联网 | 2023-08-28 15:20

hive分为四种存储格式: 1.TEXTFILE2.SEQUENCEFILE3.RCFILE4.ORCFILE在其中textfile为默认格式,如果在创建hive表不提及,

hive分为四种存储格式:

1.TEXTFILE

2.SEQUENCEFILE

3.RCFILE

4.ORCFILE

在其中textfile为默认格式,如果在创建hive表不提及,会默认启动textfile格式,导入数据时会直接把数据文件拷贝到hdfs上不进行处理;与此同时,sequencefile,rcfile,orcfile自己不能直接从本地导入数据,需要将数据转为textfile格式,才能导入三种不同的格式。

创建一个textfile格式的表:

CREATE table if not exists textfile_table

(

ueserid STRING,

movieid STRING,

rating STRING,

ts STRING

)

row formated delimated fields terminated by '\t'

stored as textfile

LOAD DATA LOCAL INPATH "/root/practice/rating.csv" OVERWRITE INTO TABLE textfile_table

1.TEXTFILE

理论部分:

默认格式,数据不做压缩,磁盘开销大,数据解析开销大。

可结合Gzip、Bzip2使用(系统自动检查,执行查询时自动解压),但使用这种方式,hive不会对数据进行切分,

从而无法对数据进行并行操作。

存储方式:行存储

实践部分:

create table if not exists textfile_table

(

ueserid STRING,

movieid STRING,

rating STRING,

ts STRING

)

row format delimited fields terminated by '\t'

stored as textfile;

set hive.exec.compress.output=true;

set mapred.output.compress=true;

set mapred.output.compression.codec=org.apache.hadoop.io.compress.GzipCodec;

set io.compression.codecs=org.apache.hadoop.io.compress.GzipCodec;

insert overwrite table textfile_table select * from textfile_table;

2.SEQUENCEFILE

理论部分:

二进制文件,以的形式序列化到文件中,SequenceFile是Hadoop API提供的一种二进制文件支持,其具有使用方便、可分割、可压缩的特点。SequenceFile支持三种压缩选择:NONE,RECORD,BLOCK。Record压缩率低,一般建议使用BLOCK压缩。

存储方式:行存储

实践部分:

create table if not exists seqfile_table

(

ueserid STRING,

movieid STRING,

rating STRING,

ts STRING

)

row format delimited

fields terminated by '\t'

stored as sequencefile;

set hive.exec.compress.output=true;

set mapred.output.compress=true;

set mapred.output.compression.codec=org.apache.hadoop.io.compress.GzipCodec;

set io.compression.codecs=org.apache.hadoop.io.compress.GzipCodec;

SET mapred.output.compression.type=BLOCK;

insert overwrite table seqfile_table select * from textfile_table;

3.RCFILE

理论部分:

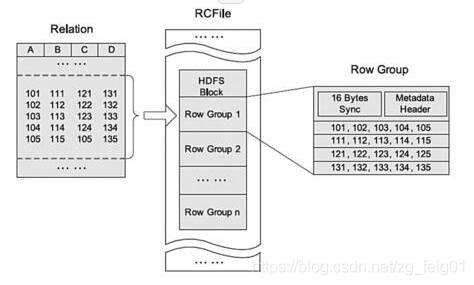

RCFile文件格式是FaceBook开源的一种Hive的文件存储格式,首先将表分为几个行组,对每个行组内的数据进行按列存储,每一列的数据都是分开存储,正是先水平划分,再垂直划分的理念。

首先对表进行行划分,分成多个行组。一个行组主要包括:16字节的HDFS同步块信息,主要是为了区分一个HDFS块上的相邻行组;元数据的头部信息主要包括该行组内的存储的行数、列的字段信息等等;数据部分我们可以看出RCFile将每一行,存储为一列,将一列存储为一行,因为当表很大,我们的字段很多的时候,我们往往只需要取出固定的一列就可以。

在一般的行存储中 select a from table,虽然只是取出一个字段的值,但是还是会遍历整个表,所以效果和select * from table 一样,在RCFile中,像前面说的情况,只会读取该行组的一行。

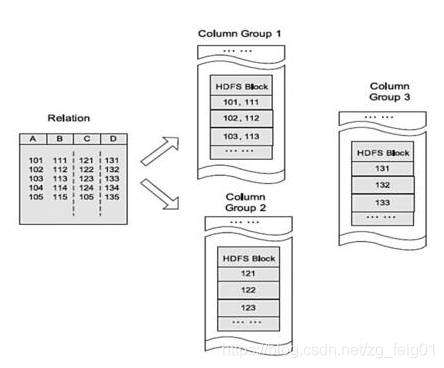

在一般的列存储中,会将不同的列分开存储,这样在查询的时候会跳过某些列,但是有时候存在一个表的有些列不在同一个HDFS块上(如下图),所以在查询的时候,Hive重组列的过程会浪费很多IO开销。而RCFile由于相同的列都是在一个HDFS块上,所以相对列存储而言会节省很多资源

在存储空间上:

行划分 列存储,RCFile采用游程编码,相同的数据不会重复存储,很大程度上节约了存储空间,尤其是字段中包含大量重复数据的时候。

懒加载:

数据存储到表中都是压缩的数据,Hive读取数据的时候会对其进行解压缩,但是会针对特定的查询跳过不需要的列,这样也就省去了无用的列解压缩。

select c from table where a>1

针对行组来说,会对一个行组的a列进行解压缩,如果当前列中有a>1的值,然后才去解压缩c。若当前行组中不存在a>1的列,那就不用解压缩c,从而跳过整个行组。

实践部分:

create table if not exists rcfile_table

(

ueserid STRING,

movieid STRING,

rating STRING,

ts STRING

)

row format delimited fields terminated by '\t'

stored as rcfile;

set hive.exec.compress.output=true;

set mapred.output.compress=true;

set mapred.output.compression.codec=org.apache.hadoop.io.compress.GzipCodec;

set io.compression.codecs=org.apache.hadoop.io.compress.GzipCodec;

insert overwrite table rcfile_table select * from textfile_table;

4.ORCFILE

理论部分:

ORC是在一定程度上扩展了RCFile,是对RCFile的优化。

- ORC是列式存储,有多种文件压缩方式,并且有着很高的压缩比。

- 文件是可切分(Split)的。因此,在Hive中使用ORC作为表的文件存储格式,不仅节省HDFS存储资源,查询任务的输入数据量减少,使用的MapTask也就减少了。

- 提供了多种索引,row group index、bloom filter index。

- ORC可以支持复杂的数据结构(比如Map等)

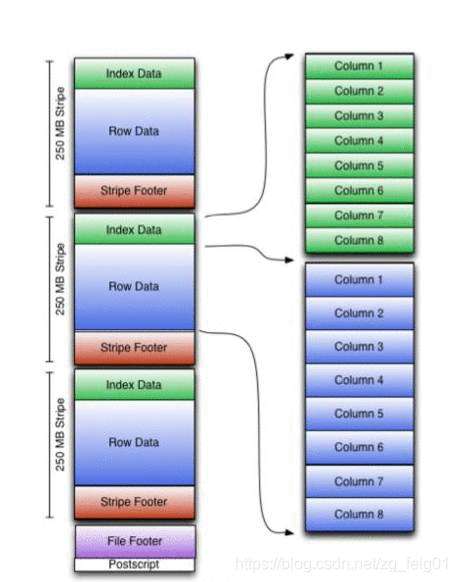

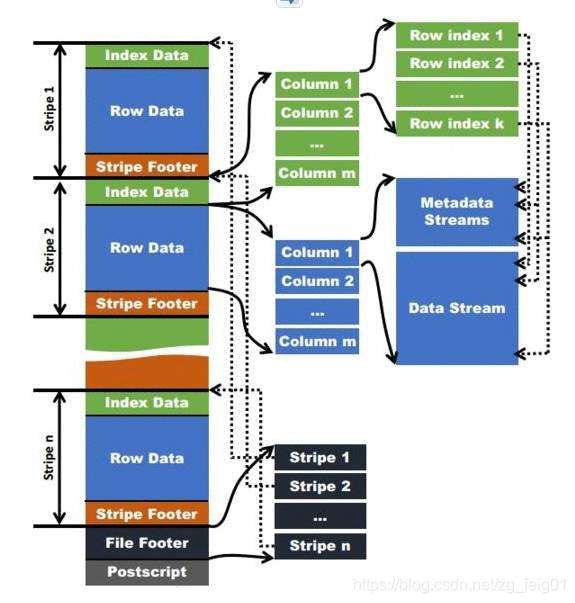

存储结构上

stripe划分 列存储,根据结构图,我们可以看到ORCFile在RCFile基础上引申出来Stripe和Footer等。每个ORC文件首先会被横向切分成多个Stripe,而每个Stripe内部以列存储,所有的列存储在一个文件中,而且每个stripe默认的大小是250MB,相对于RCFile默认的行组大小是4MB,所以比RCFile更高效。

Postscripts中存储该表的行数,压缩参数,压缩大小,列等信息

Stripe Footer中包含该stripe的统计结果,包括Max,Min,count等信息

FileFooter中包含该表的统计结果,以及各个Stripe的位置信息

IndexData中保存了该stripe上数据的位置信息,总行数等信息

RowData以stream的形式保存了数据的具体信息

Hive读取数据的时候,根据FileFooter读出Stripe的信息,根据IndexData读出数据的偏移量从而读取出数据。

网友有一幅图,形象的说明了这个问题:

ORCFile扩展了RCFile的压缩,除了Run-length(游程编码),引入了字典编码和Bit编码。

采用字典编码,最后存储的数据便是

字典中的值,每个字典值得长度以及字段在字典中的位置

至于Bit编码,对所有字段都可采用Bit编码来判断该列是否为null,

如果为null则Bit值存为0,否则存为1,对于为null的字段在实际编码的时候不需要存储,也就是说字段若为null,是不占用存储空间的。

所有关于ORCFile的参数都是在Hive QL语句的TBLPROPERTIES字段里面出现,他们是:

Key | Default | Notes |

orc.compress | ZLIB | high level compression (one of NONE, ZLIB, SNAPPY) |

orc.compress.size | 262,144 | number of bytes in each compression chunk |

orc.stripe.size | 268435456 | number of bytes in each stripe |

orc.row.index.stride | 10,000 | number of rows between index entries (must be >= 1000) |

orc.create.index | true | whether to create row indexes |

实践部分:

create table if not exists orcfile_table

(

ueserid STRING,

movieid STRING,

rating STRING,

ts STRING

)

row format delimited fields terminated by '\t'

stored as orcfile;

set hive.default.fileformat=orc

set hive.exec.compress.output=true;

set mapred.output.compress=true;

set mapred.output.compression.codec=org.apache.hadoop.io.compress.GzipCodec;

set io.compression.codecs=org.apache.hadoop.io.compress.GzipCodec;

insert overwrite table orcfile_table select * from textfile_table;

总结:

textfile 存储空间消耗比较大,并且压缩的text 无法分割和合并 查询的效率最低,可以直接存储,加载数据的速度最高

sequencefile 存储空间消耗最大,压缩的文件可以分割和合并 查询效率高,需要通过text文件转化来加载

rcfile 存储空间最小,查询的效率最高 ,需要通过text文件转化来加载,加载的速度最低

相比传统的行式存储引擎,列式存储引擎具有更高的压缩比,更少的IO操作而备受青睐(注:列式存储不是万能高效的,很多场景下行式存储仍更加高效),尤其是在数据列(column)数很多,但每次操作仅针对若干列的情景,列式存储引擎的性价比更高。

在互联网大数据应用场景下,大部分情况下,数据量很大且数据字段数目很多,但每次查询数据只针对其中的少数几行,这时候列式存储是极佳的选择