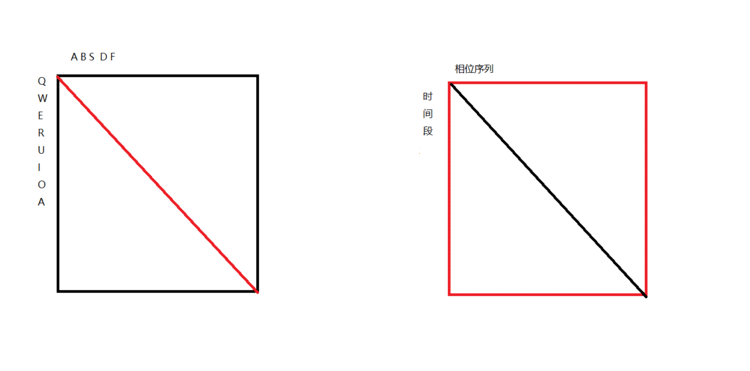

如下图所示,自注意力机制是序列本身和本身建立关系,

而傅里叶变换的实际思想是将一个函数也就是拆成多个简单的函数的组合

函数的个数是序列的个数,所以经过傅里叶变换后的序列。本身就是一个函数

也就是自注意力机制手动构造的二维自相关图。

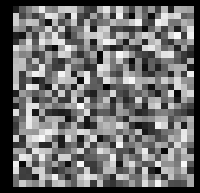

傅里叶变换后序列的时序和相位序列的相关图,每个对角位置的相位能准确的代表原来序列的振幅,这么类似的结构应该是可以代替的吧。况且本身你那个自注意力机制组成的神经网络的意义也是按照自己意思和实验结果硬分析写上去的吧

总之待验证。

x=torch.angle(torch.fft.fft(x))

看这图是不是和注意力机制的图有点像

后期会进一步进行验证

京公网安备 11010802041100号 | 京ICP备19059560号-4 | PHP1.CN 第一PHP社区 版权所有

京公网安备 11010802041100号 | 京ICP备19059560号-4 | PHP1.CN 第一PHP社区 版权所有