作者:Chinaexpoinfo | 来源:互联网 | 2023-02-05 10:58

不多说,直接上干货! 1、SqoopImport(进入官网) 因为,sqoop的使用方式是:sqoopCOMMAND ARGS。 以下是 sqoopCOMMA

不多说,直接上干货!

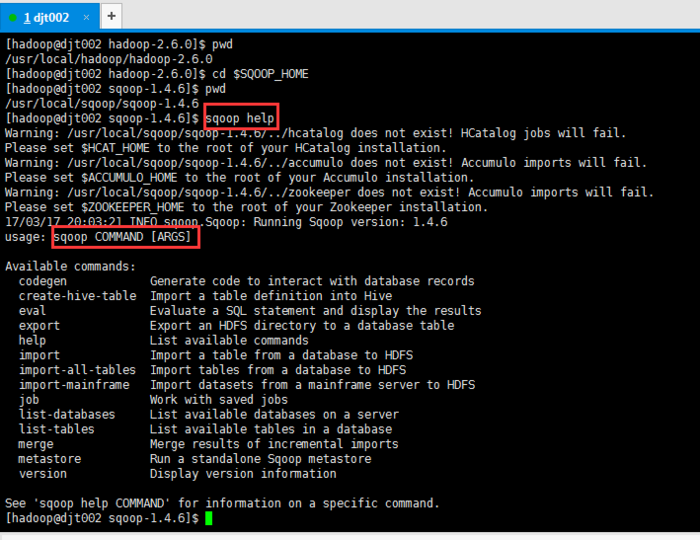

1、Sqoop Import (进入官网)

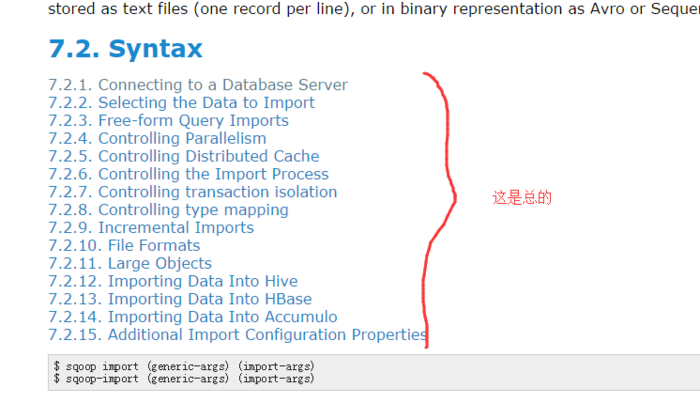

因为,sqoop的使用方式是: sqoop COMMAND ARGS。

以下是 sqoop COMMAND ARGS

以下是 sqoop COMMAND ARGS

所以,sqoop COMMAND ARGS 是

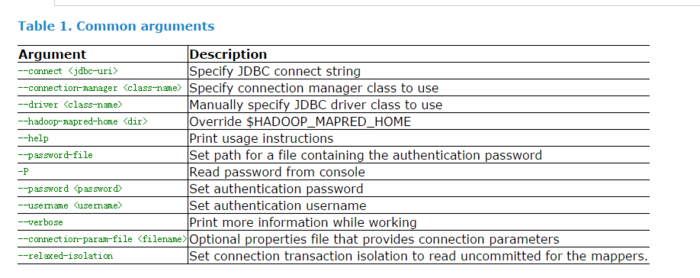

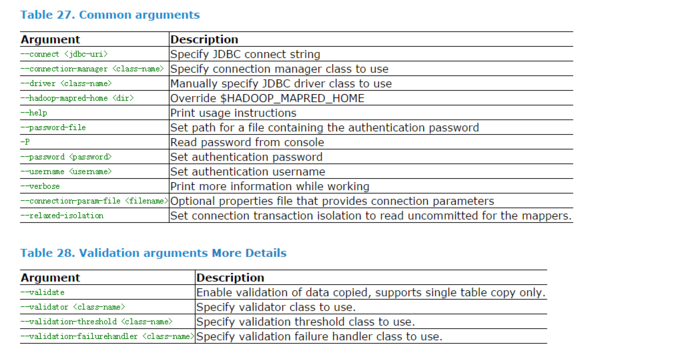

| 选项 |

含义说明 |

--connect |

指定JDBC连接字符串 |

--connection-manager |

指定要使用的连接管理器类 |

--driver |

指定要使用的JDBC驱动类 |

--hadoop-mapred-home |

指定$HADOOP_MAPRED_HOME路径 |

--help |

打印用法帮助信息 |

--password-file |

设置用于存放认证的密码信息文件的路径 |

-P |

从控制台读取输入的密码 |

--password |

设置认证密码 |

--username |

设置认证用户名 |

--verbose |

打印详细的运行信息 |

--connection-param-file |

可选,指定存储数据库连接参数的属性文件 |

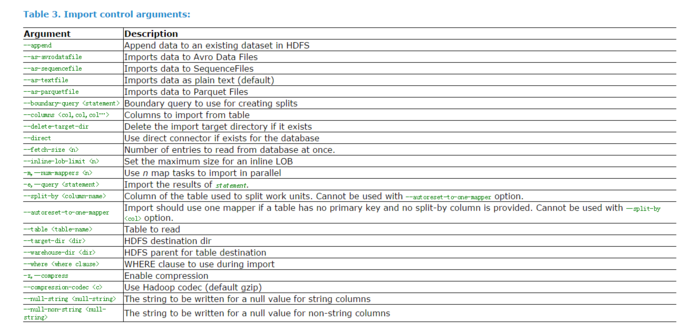

| 选项 |

含义说明 |

--append |

将数据追加到HDFS上一个已存在的数据集上 |

--as-avrodatafile |

将数据导入到Avro数据文件 |

--as-sequencefile |

将数据导入到SequenceFile |

--as-textfile |

将数据导入到普通文本文件(默认) |

--boundary-query |

边界查询,用于创建分片(InputSplit) |

--columns |

从表中导出指定的一组列的数据 |

--delete-target-dir |

如果指定目录存在,则先删除掉 |

--direct |

使用直接导入模式(优化导入速度) |

--direct-split-size |

分割输入stream的字节大小(在直接导入模式下) |

--fetch-size |

从数据库中批量读取记录数 |

--inline-lob-limit |

设置内联的LOB对象的大小 |

-m,--num-mappers |

使用n个map任务并行导入数据 |

-e,--query |

导入的查询语句 |

--split-by |

指定按照哪个列去分割数据 |

--table |

导入的源表表名 |

--target-dir |

导入HDFS的目标路径 |

--warehouse-dir |

HDFS存放表的根路径 |

--where |

指定导出时所使用的查询条件 |

-z,--compress |

启用压缩 |

--compression-codec |

指定Hadoop的codec方式(默认gzip) |

--null-string |

果指定列为字符串类型,使用指定字符串替换值为null的该类列的值 |

--null-non-string |

如果指定列为非字符串类型,使用指定字符串替换值为nul |

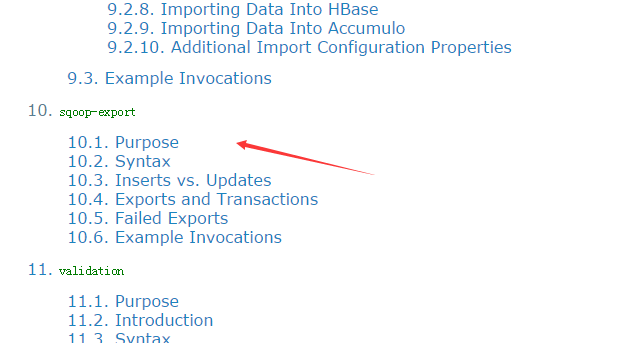

2、Sqoop Export (进入官网)

| 选项 |

含义说明 |

--validate |

启用数据副本验证功能,仅支持单表拷贝,可以指定验证使用的实现类 |

--validation-threshold |

指定验证门限所使用的类 |

--direct |

使用直接导出模式(优化速度) |

--export-dir |

导出过程中HDFS源路径 |

-m,--num-mappers |

使用n个map任务并行导出 |

--table |

导出的目的表名称 |

--call |

导出数据调用的指定存储过程名 |

--update-key |

更新参考的列名称,多个列名使用逗号分隔 |

--update-mode |

指定更新策略,包括:updateonly(默认)、allowinsert |

--input-null-string |

使用指定字符串,替换字符串类型值为null的列 |

--input-null-non-string |

使用指定字符串,替换非字符串类型值为null的列 |

--staging-table |

在数据导出到数据库之前,数据临时存放的表名称 |

--clear-staging-table |

清除工作区中临时存放的数据 |

--batch |

使用批量模式导出 |