大家好~本课程为“深度学习基础班”的线上课程,带领同学从0开始学习全连接和卷积神经网络,进行数学推导,并且实现可以运行的Demo程序

线上课程资料:

本节课录像回放

加QQ群,获得ppt等资料,与群主交流讨论:106047770

本系列文章为线上课程的复盘,每上完一节课就会同步发布对应的文章

本课程系列文章可进入索引查看:

深度学习基础课系列文章索引

目录

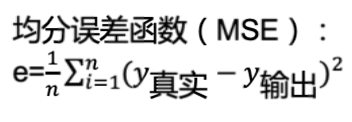

\[\begin{aligned}

\frac{dE}{dw_{kj}} &=\delta_k a_j \\

&= \frac{dE}{dy_k}\frac{df(net_k)}{dnet_k} a_j \\

&=-\frac {2}{n}(y_{真实}-y_k) \frac{df(net_k)}{dnet_k} a_j

\end{aligned}

\]

\[\begin{aligned}

E = ?从而

\frac{dE}{dy_k}\frac{df(net_k)}{dnet_k} = \delta_k = y_k - y_{真实} \\

\end{aligned}

\]

答:

\[e = - \frac {1}{n} \sum_{i=1}^n (y_{真实}\ln{y_{输出}} + (1-y_{真实})\ln{(1-y_{输出})})

\]

答:待实现的代码为:CrossEntropyLoss_gender,实现后的代码为:CrossEntropyLoss_gender_answer

答:我们取20轮的训练结果

之前的代码的运行结果:

[ 'loss: ', 0.4507304592177789 ]

[ 'loss: ', 0.42877150239298367 ]

[ 'loss: ', 0.4003410570050336 ]

[ 'loss: ', 0.36471054740582803 ]

[ 'loss: ', 0.32348350190262276 ]

[ 'loss: ', 0.28148842822336106 ]

[ 'loss: ', 0.24435904667566208 ]

[ 'loss: ', 0.21478940821264678 ]

[ 'loss: ', 0.19217920769398236 ]

[ 'loss: ', 0.1746959045869208 ]

[ 'loss: ', 0.16069147885466947 ]

[ 'loss: ', 0.14903993518214445 ]

[ 'loss: ', 0.13904224985035976 ]

[ 'loss: ', 0.13027401434711444 ]

[ 'loss: ', 0.12247365805566274 ]

[ 'loss: ', 0.11547411658524662 ]

[ 'loss: ', 0.10916376857366585 ]

[ 'loss: ', 0.1034647748090702 ]

[ 'loss: ', 0.09832137076163855 ]

[ 'loss: ', 0.09369385876122124 ]

现在的代码的运行结果:

[ 'loss: ', 0.9942633398183269 ]

[ 'loss: ', 0.6659776522867806 ]

[ 'loss: ', 0.49140689993232145 ]

[ 'loss: ', 0.37709033494651706 ]

[ 'loss: ', 0.2994042613488786 ]

[ 'loss: ', 0.22748275377361313 ]

[ 'loss: ', 0.178710734329234 ]

[ 'loss: ', 0.14814081504087312 ]

[ 'loss: ', 0.1262728567509965 ]

[ 'loss: ', 0.10981773645519985 ]

[ 'loss: ', 0.09701072087557354 ]

[ 'loss: ', 0.08678048289782145 ]

[ 'loss: ', 0.07843471667890223 ]

[ 'loss: ', 0.07150614449993825 ]

[ 'loss: ', 0.06566841165919438 ]

[ 'loss: ', 0.06068705773306658 ]

[ 'loss: ', 0.05638955210782751 ]

[ 'loss: ', 0.05264627797401171 ]

[ 'loss: ', 0.049358078224151274 ]

[ 'loss: ', 0.04644787505022075 ]

通过比较最后一轮的结果,我们可以看到现在的代码的loss更接近0,所以更加收敛;

通过比较前三轮的结果,我们可以看到现在的代码在loss很大时训练速度更快

欢迎来到Wonder~

扫码加入我的QQ群:

扫码加入免费知识星球-YYC的Web3D旅程:

扫码关注微信公众号:

京公网安备 11010802041100号 | 京ICP备19059560号-4 | PHP1.CN 第一PHP社区 版权所有

京公网安备 11010802041100号 | 京ICP备19059560号-4 | PHP1.CN 第一PHP社区 版权所有