作者:adu | 来源:互联网 | 2023-09-16 15:06

文章目录引言二、项目环境配置二、数据集介绍三、代码介绍四、测试1.代码执行流程数据代码见:https:gitee.comlj857335332bert_finetun

文章目录

- 引言

- 二、项目环境配置

- 二、数据集介绍

- 三、代码介绍

- 四、测试

- 数据代码见:https://gitee.com/lj857335332/bert_finetune_cls_adversarial_training

引言

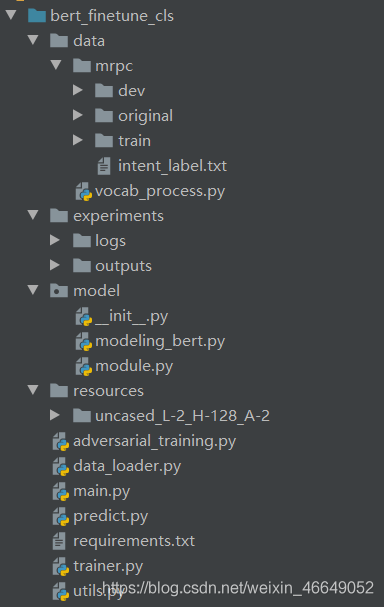

这一节学习BERT模型如何在句子分类任务上进行微调。项目代码框架如下:

争取做到每一行代码都有注释!!!

二、项目环境配置

- python>=3.6

- torch==1.6.0

- transformers==3.0.2

- seqeval==0.0.12

二、数据集介绍

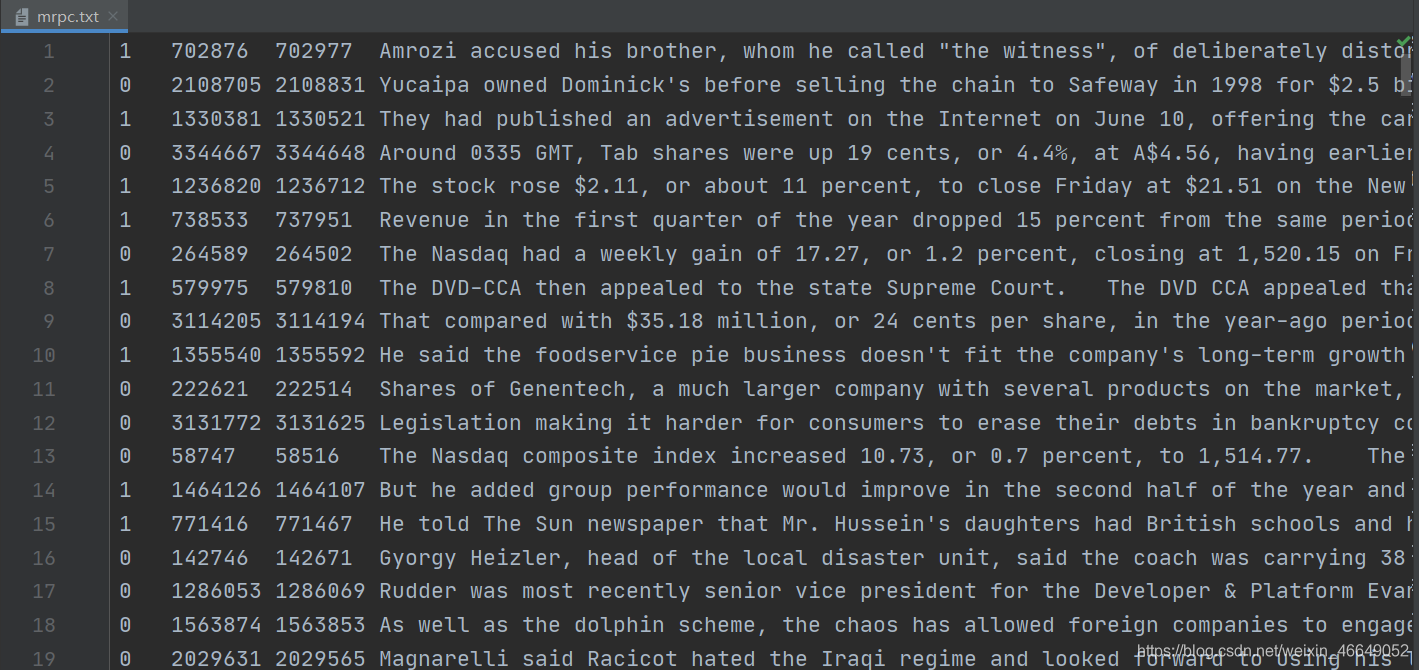

该项目使用的是mrpc数据集,该数据集由微软发布,判断两个给定句子,是否具有相同的语义,属于句子对的文本二分类任务;有的句子对是同义的,表示为1;有的是不同义的,表示为0。

| Train | Dev | Labels |

|---|

| MRPC | 4076 | 1725 | 2 |

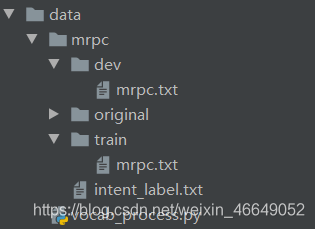

我们这一节使用mrpc数据,数据集由训练集、验证集组成

mrpc.txt文件:每一行是一个文本,分别包括标签、文本等

intent_label.txt文件:每一行一个意图标签,一共有两个,分别表示句子相似与句子不相似;这个文件是由vocab_process.py文件生成的意图标签统计文件

三、代码介绍

data_loader.py文件:这个文件的功能是将文本文件转化成InputExample类数据,并将输入样本转化为bert能够读取的InputFeatures类数据,最后保存至cache文件中,方便下次快速加载。utils.py文件:封装了很多实用程序,方便统一调用trainer.py文件:定义了任务的训练与评估以及保存模型与加载模型main.py文件:用于模型的训练与评估predict.py文件:用于模型的预测adversarial_training.py文件:对抗训练代码实现,详情可见:对抗训练原理与代码实现

四、测试

1.代码执行流程

在命令行输入,

python bert_finetune_cls/main.py --data_dir bert_finetune_cls/data/ --task mrpc --model_type bert --model_dir bert_finetune_cls/experiments/outputs --do_train --do_eval --train_batch_size 8 --num_train_epochs 2 --linear_learning_rate 5e-4

如果使用对抗训练,则

python bert_finetune_cls/main.py --data_dir bert_finetune_cls/data/ --task mrpc --model_type bert --model_dir bert_finetune_cls/experiments/outputs/clsbert_0 --do_train --do_eval --train_batch_size 8 --num_train_epochs 2 --linear_learning_rate 5e-4 --at_method fgm

如果对您有帮助,麻烦点赞关注,这真的对我很重要!!!如果需要互关,请评论或者私信!