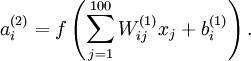

训练完(稀疏)自编码器,我们还想把这自编码器学习到的函数可视化出来,好弄明白它到底学到了什么。我们以在10×10图像(即n=100)上训练自编码器为例。在该自编码器中,每个隐藏单元i对如下关于输入的函数进行计算:

我们将要可视化的函数,就是上面这个以2D图像为输入,并由隐藏单元i计算出来的函数。它是依赖于参数 的(暂时忽略偏置项bi)。需要注意的是,

的(暂时忽略偏置项bi)。需要注意的是, 可看作输入

可看作输入 的非线性特征。不过还有个问题:什么样的输入图像x可以让可让

的非线性特征。不过还有个问题:什么样的输入图像x可以让可让 得到最大程度的激励?(通俗一点说,隐藏单元

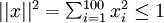

得到最大程度的激励?(通俗一点说,隐藏单元 要找个什么样的特征?)。这里我们必须给x加个约束,否则会得到平凡解。若假设输入有范数约束

要找个什么样的特征?)。这里我们必须给x加个约束,否则会得到平凡解。若假设输入有范数约束 ,则可证。令隐藏单元i得到最大激励的输入应该由下面公式计算的像素

,则可证。令隐藏单元i得到最大激励的输入应该由下面公式计算的像素 给出(共需计算100个像素,j=1,...,100):

给出(共需计算100个像素,j=1,...,100):

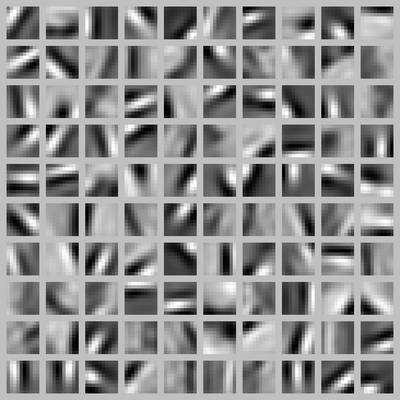

当我们用上式算出各像素的值、把它们组成一幅图像、并将图像呈现在我们面前之时,隐藏单元i所追寻特征的真正含义也渐渐明朗起来???。

假如我们训练的自编码器有100个隐藏单元,可视化结果就会包含100幅这样的图像——每个隐藏单元都对应一幅图像。审视这100幅图像,我们可以试着体会这些隐藏单元学出来的整体效果是什么样的。

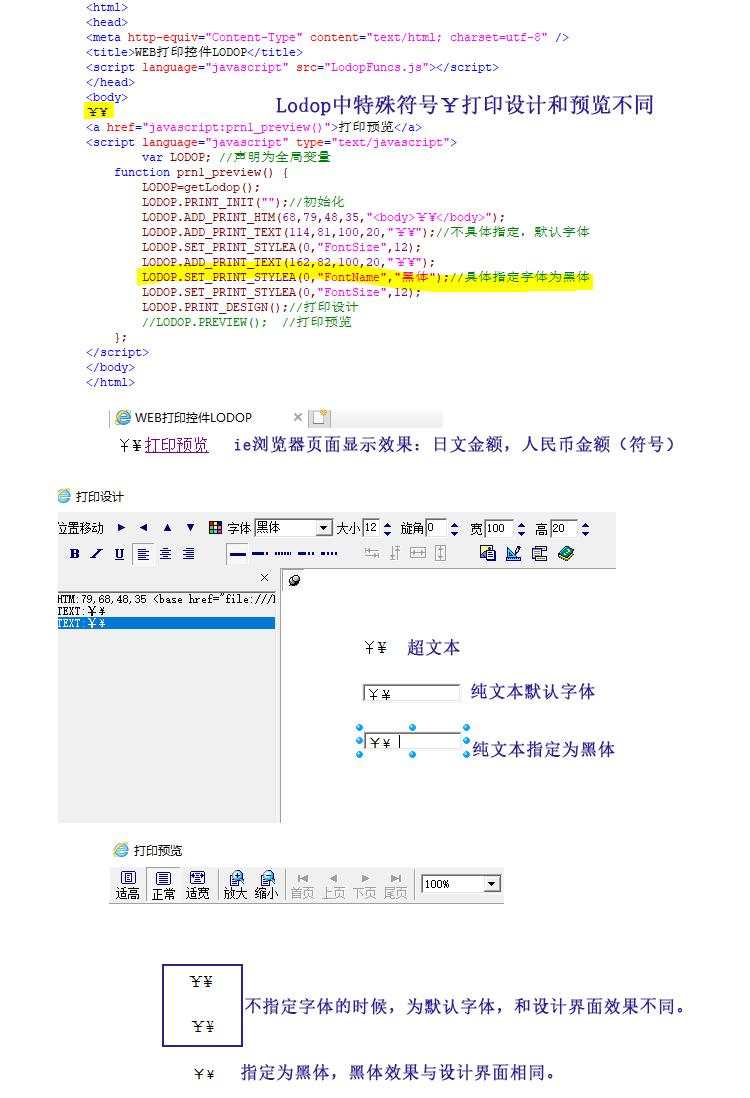

当我们对稀疏自编码器(100个隐藏单元,在10X10像素的输入上训练 )进行上述可视化处理之后,结果如下所示:

上图的每一个小方块都给出可一个(带有有界范数的)输入图像x,它可以使这100个隐藏单元中的某一个获得最大激励。我们可以看到,不同的隐藏单元学会了在图像的不同位置和方向进行边缘检测。

显而易见,这些特征对物体识别等计算视觉任务是十分有用的。若将其用于其他输入域(如音频),该算法也可学到对这些输入域有用的表示或特征。

稀疏自编码器符号一览表

下面是我们在推导sparse autoencoder时使用的符号一览表:

| 符号 | 含义 |

| 训练样本的输入特征, . . |

| 输出值/目标值. 这里  可以是向量. 在autoencoder中, 可以是向量. 在autoencoder中, . . |

| 第  个训练样本 个训练样本 |

| 输入为  时的假设输出,其中包含参数 时的假设输出,其中包含参数 . 该输出应当与目标值 . 该输出应当与目标值  具有相同的维数. 具有相同的维数. |

| 连接第  层 层  单元和第 单元和第  层 层  单元的参数. 单元的参数. |

| 第  层 层  单元的偏置项. 也可以看作是连接第 单元的偏置项. 也可以看作是连接第  层偏置单元和第 层偏置单元和第  层 层  单元的参数. 单元的参数. |

| 参数向量. 可以认为该向量是通过将参数 组合展开为一个长的列向量而得到. 组合展开为一个长的列向量而得到. |

| 网络中第  层 层  单元的激活(输出)值. 单元的激活(输出)值. 另外,由于 |

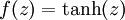

| 激活函数. 本文中我们使用  . . |

| 第  层 层  单元所有输入的加权和. 因此有 单元所有输入的加权和. 因此有  . . |

| 学习率 |

| 第  层的单元数目(不包含偏置单元). 层的单元数目(不包含偏置单元). |

| 网络中的层数. 通常  层是输入层, 层是输入层, 层是输出层. 层是输出层. |

| 权重衰减系数. |

| 对于一个autoencoder,该符号表示其输出值;亦即输入值  的重构值. 与 的重构值. 与  含义相同. 含义相同. |

| 稀疏值,可以用它指定我们所需的稀疏程度 |

| (sparse autoencoder中)隐藏单元  的平均激活值. 的平均激活值. |

| (sparse autoencoder目标函数中)稀疏值惩罚项的权重. |

.

.

京公网安备 11010802041100号

京公网安备 11010802041100号