[转载]AdaBoost算法

原文:https://blog.csdn.net/v_july_v/article/details/40718799

这里就不转载了,到原文看吧。但是有几点可以注意下:

- 上一个基本分类器训练出来的权值是下一个基本分类器的初始权值。并且每次分类器更新后,预测时都是这个分类器和前面的分类器的组合,例如原文中的

f3(x)=0.4236G1(x) + 0.6496G2(x)+0.7514G3(x) - 一个基本分类器只更新一次权值

- 基本分类器的构建在精度达到某一要求的时候停止

- Adaboost的误差上界公式表明:复合分类器的误差随基本分类器的最小误差指数下降

注意原文有一个公式错了:

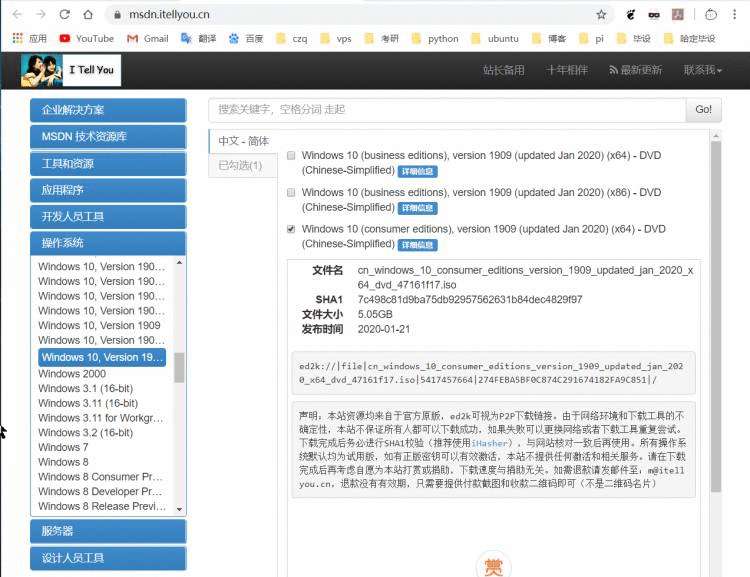

在推导AdaBoost的误差界的时候:

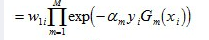

w的前面应该加一个求和号,具体可以参考这个公式的下一个式子

京公网安备 11010802041100号

京公网安备 11010802041100号